Una compleja maniobra de desinformación internacional quedó al descubierto en los últimos días y puso el foco sobre Argentina. Se trata de una red vinculada a intereses rusos que utilizó inteligencia artificial para crear periodistas falsos y difundir contenidos políticos en distintos medios digitales del país, con el objetivo de influir en la opinión pública y posicionar determinadas narrativas.

El esquema, que fue reconstruido a partir de documentos filtrados, muestra un mecanismo sofisticado que combinó tecnología, financiamiento y estrategias de manipulación informativa. En el centro de la operación aparece la creación de identidades ficticias que firmaban artículos periodísticos, dando apariencia de legitimidad a publicaciones que en realidad respondían a intereses geopolíticos externos.

Según se pudo determinar, uno de los recursos más utilizados fue la generación de perfiles completos mediante inteligencia artificial. Estos “periodistas” contaban con nombres, fotos, trayectorias académicas y especializaciones que, a simple vista, parecían creíbles. Sin embargo, al ser sometidos a verificación, no existía ningún registro real de estas personas.

En muchos casos, los artículos eran publicados sin autoría clara o bajo firmas que no podían ser rastreadas en el ámbito profesional o académico. Este detalle, que podría pasar desapercibido para el lector común, formaba parte de una estrategia deliberada para insertar contenido en la agenda mediática sin levantar sospechas.

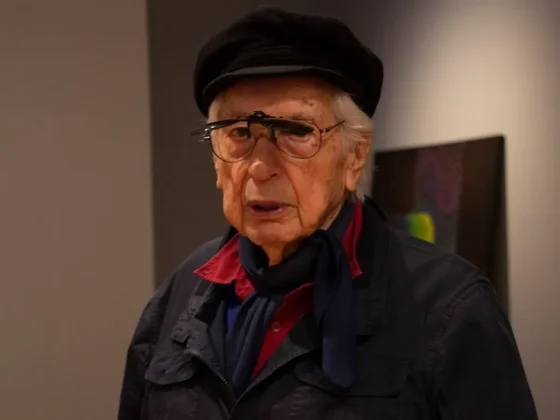

Uno de los ejemplos más llamativos es el de Manuel Godsin, un supuesto analista político que firmó notas relacionadas con protestas universitarias y conflictos sociales en el país. En su perfil, se presentaba como doctor egresado de una universidad europea y miembro de un centro de estudios estratégicos. Sin embargo, ninguna de estas credenciales pudo ser corroborada.

La investigación reveló que la imagen utilizada para representar a Godsin correspondía en realidad a un ciudadano ruso, lo que terminó de confirmar que se trataba de una identidad completamente fabricada. Este tipo de perfiles no solo eran utilizados en Argentina, sino que también habían sido detectados previamente en otros continentes, replicando el mismo patrón de desinformación.

A este caso se suman otras firmas que también fueron identificadas como parte del entramado. Nombres como Gabriel Di Taranto, Juan Carlos López y Marcelo Lopreiatto aparecieron como autores de múltiples artículos en distintos portales digitales. En todos los casos, las identidades resultaron ser inexistentes o construidas a partir de imágenes generadas digitalmente o extraídas de bancos de fotos.

El caso de Di Taranto resulta particularmente significativo. Se lo presentaba como especialista en comunicación política con estudios de posgrado en una universidad nacional. No obstante, la institución desmintió cualquier vínculo con esa persona y aseguró que nunca formó parte de su comunidad académica. Además, se comprobó que su imagen había sido creada mediante software especializado y reutilizada en distintos perfiles en internet.

Algo similar ocurrió con Juan Carlos López, cuya fotografía provenía de un banco de imágenes y estaba asociada a múltiples identidades en redes sociales. Este dato refuerza la hipótesis de que la red operaba con recursos digitales diseñados específicamente para construir personajes creíbles sin necesidad de recurrir a personas reales.

Por su parte, Marcelo Lopreiatto también firmó numerosas publicaciones. Su rostro había sido utilizado previamente en campañas promocionales vinculadas a retratos generados con inteligencia artificial, lo que evidencia el uso sistemático de este tipo de herramientas en la operación.

Los documentos analizados indican que varios de estos contenidos fueron publicados en sitios de alcance nacional, con un volumen considerable de artículos. Incluso, se detallan montos de dinero asociados a la difusión de estas notas, lo que da cuenta de una estructura organizada y con financiamiento definido.

Más allá de los nombres puntuales, lo que preocupa a especialistas es la metodología empleada. La utilización de inteligencia artificial para crear identidades falsas representa un salto cualitativo en las estrategias de desinformación. Ya no se trata solamente de noticias falsas, sino de la construcción de voces aparentemente autorizadas que instalan determinados discursos en el debate público.

En este contexto, Argentina aparece como uno de los escenarios donde se desplegó esta operatoria, en medio de un clima político atravesado por tensiones y fuertes discusiones ideológicas. Los contenidos difundidos apuntaban, en gran medida, a cuestionar decisiones del Gobierno nacional y a amplificar conflictos sociales, buscando incidir en la percepción de la ciudadanía.

Si bien este tipo de maniobras no es nuevo a nivel global, la incorporación de herramientas de inteligencia artificial permite escalar la producción de contenido y mejorar la calidad de las falsificaciones. Esto dificulta su detección y aumenta su impacto potencial.

En Salta, donde el consumo de información digital crece de manera sostenida y las redes sociales juegan un rol central en la circulación de noticias, este tipo de fenómenos también genera preocupación. La posibilidad de que contenidos manipulados lleguen a audiencias locales sin filtros plantea un desafío tanto para los medios como para los propios lectores.

Frente a este escenario, especialistas recomiendan prestar atención a ciertos indicadores: verificar la existencia de los autores, desconfiar de perfiles sin trayectoria comprobable y contrastar la información con múltiples fuentes. También destacan la importancia del periodismo profesional y del trabajo en redacciones que validan datos antes de publicar.

El avance de la inteligencia artificial abre oportunidades, pero también riesgos. En este caso, quedó en evidencia cómo puede ser utilizada para construir una realidad paralela que influya en la opinión pública sin que los lectores lo adviertan.

La investigación continúa y no se descarta que surjan nuevos datos sobre el alcance de esta red en el país. Mientras tanto, el caso deja una advertencia clara: en la era digital, la batalla por la información no solo se libra en los contenidos, sino también en la identidad de quienes los producen.